Deutsche Unternehmen wollen KI einsetzen. Die Technologie ist reif, die Anwendungsfälle sind klar, der Wettbewerbsdruck steigt. Und dann kommt die Frage: Was ist mit dem Datenschutz?

In vielen Unternehmen führt diese Frage zur Lahmlegung. Der Datenschutzbeauftragte sagt "muss ich prüfen". Die IT sagt "On-Premise wäre sicherer". Die Geschäftsführung sagt "erstmal abwarten". Monate vergehen. Nichts passiert.

Das ist unnötig. Wer die Infrastruktur richtig aufbaut, hat 90 Prozent des Datenschutzes gelöst. Nicht durch Gutachten, sondern durch Architektur.

Die meisten Datenschutz-Bedenken sind Infrastruktur-Probleme

Wenn Unternehmen fragen "Dürfen wir das?", meinen sie meistens: Dürfen unsere Mitarbeiterdaten, Kundendaten, Geschäftszahlen auf fremden Servern liegen? Werden sie zum Training verwendet? Wer hat Zugriff?

Das sind berechtigte Fragen. Aber es sind keine Rechtsfragen, die ein Anwalt klären muss. Es sind technische Fragen, die sich durch die richtige Infrastruktur beantworten lassen.

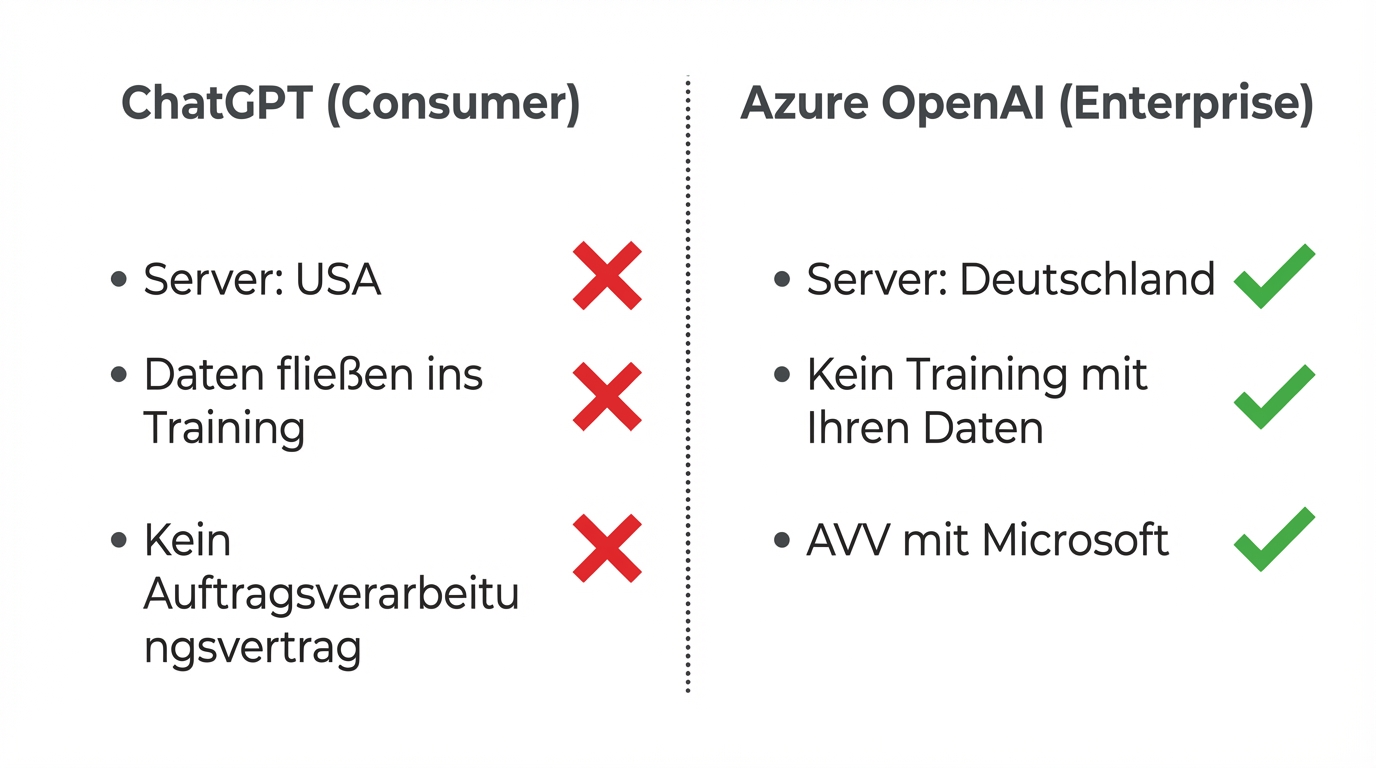

Der Kern: Es gibt einen fundamentalen Unterschied zwischen ChatGPT, dem Consumer-Produkt, und Azure OpenAI, der Enterprise-Infrastruktur. ChatGPT läuft auf amerikanischen Servern. Private Accounts speisen Daten ins Training ein. Für Unternehmenszwecke ist das keine Option.

Azure OpenAI ist etwas völlig anderes. Die gleichen Modelle (GPT-4, GPT-4o) laufen auf Microsoft-Servern in deutschen Rechenzentren. Keine Daten fließen ins Training. Der Zugriff durch Microsoft ist vertraglich auf technische Problembehebung beschränkt. Die Vertragsstruktur ist identisch mit der, die Ihr Unternehmen vermutlich bereits für Office 365 oder Azure Cloud akzeptiert hat.

Das ist der entscheidende Punkt: Wenn Sie Microsoft-Produkte einsetzen, haben Sie die Datenschutz-Entscheidung im Grunde schon getroffen. Azure OpenAI ist rechtlich und technisch derselbe Rahmen.

Warum On-Premise fast immer der falsche Weg ist

Die intuitive Reaktion vieler IT-Leiter: Wenn Datenschutz das Problem ist, hosten wir eben selbst. Eigene Server, eigene Modelle, volle Kontrolle.

Das klingt vernünftig. In der Praxis ist es meistens die teuerste und schlechteste Lösung.

On-Premise-KI bedeutet: Open-Source-Modelle wie Llama, KIMI oder QWEN. Diese Modelle werden besser, Monat für Monat. Aber sie sind heute noch deutlich hinter den proprietären Modellen von OpenAI und Anthropic. Was bei GPT-4o zuverlässig funktioniert, produziert mit Open-Source-Modellen häufig Fehler, die teurer sind als der vermeintliche Datenschutz-Vorteil.

Dazu kommt die Hardware: mindestens 100.000 Euro für einen brauchbaren GPU-Cluster, 1 TB RAM, laufende Wartung, Modell-Updates, Fachpersonal. Ein Wettbewerber, der GPU-Cluster im Keller betreibt, ist erfahrungsgemäß 20 Versionen hinter dem Stand der Technik.

On-Premise ist gerechtfertigt in genau einem Fall: absolute Geheimhaltung. Rüstungsindustrie. Nachrichtendienste. Szenarien, in denen selbst eine vertraglich abgesicherte Cloud-Lösung politisch inakzeptabel ist.

Für alle anderen gilt: Die Kombination aus Azure-Hosting in Deutschland, vertraglicher Absicherung und technischem Systemdesign bietet mehr Sicherheit als ein selbst betriebener Server, zu einem Bruchteil der Kosten.

Die drei Säulen: So sieht datenschutzkonforme KI konkret aus

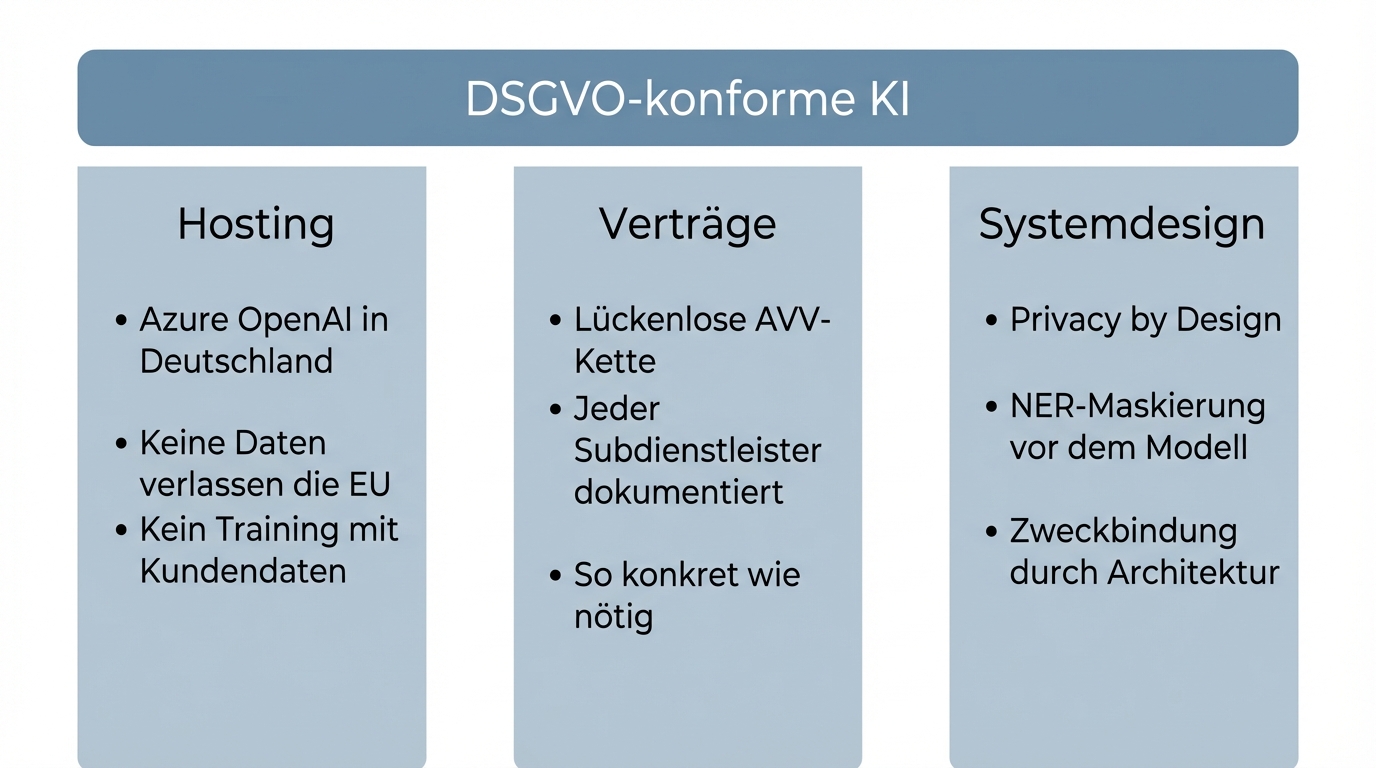

DSGVO-konforme KI steht auf drei Säulen. Jede für sich ist notwendig, zusammen sind sie ausreichend.

1. Hosting und Infrastruktur: Deutsche Server, klare Grenzen

- Azure OpenAI auf deutschen Servern: Modelle laufen in deutschen Rechenzentren. Keine Daten verlassen die EU.

- Kein Training mit Ihren Daten: Vertraglich ausgeschlossen. Ihre Unternehmensdaten fließen nicht in Modell-Updates ein.

- Zugriff durch Microsoft: Beschränkt auf technische Problembehebung, vertraglich fixiert. Gleiche Logik wie bei Office 365.

In der Praxis reicht diese vertragliche Absicherung für die allermeisten Unternehmen aus. Wer Microsoft-Produkte wie Office 365 bereits einsetzt, hat diesen Rahmenvertrag im Grunde schon akzeptiert. Azure OpenAI ist der pragmatische Königsweg.

2. Verträge und AVV-Kette: Lückenlos und transparent

Jeder Dienstleister in der Kette braucht einen Auftragsverarbeitungsvertrag. Das klingt bürokratisch, ist aber in der Praxis überschaubar, wenn man es von Anfang an richtig macht.

Eine typische AVV-Kette sieht so aus: Ihr Unternehmen schließt einen AVV mit dem Implementierungspartner. Der Implementierungspartner hat AVVs mit seinen Subdienstleistern. Jeder Vertrag dokumentiert, wo Daten liegen und wer Zugriff hat.

Beispiel aus einem realen Projekt: Kunde, Implementierungspartner, Langfuse (Monitoring), AWS (Hosting), ClickHouse (Datenbank). Jede Station vertraglich abgesichert, jede transparent dokumentiert.

Wichtig dabei: Die Verträge müssen so konkret wie nötig und so abstrakt wie möglich sein. Wer jedes Implementierungsdetail in den AVV schreibt, braucht bei jeder technischen Änderung eine Vertragsanpassung. Das ist weder praktikabel noch notwendig.

3. Systemdesign: Privacy by Design statt nachträglicher Absicherung

Die dritte Säule ist die wichtigste, weil sie technisch erzwingt, was Verträge nur versprechen.

- Pseudonymisierung: Customer-IDs statt Klarnamen. Wo möglich, sieht das KI-Modell keine personenbezogenen Daten.

- Lokale NER-Modelle: Named Entity Recognition erkennt und maskiert personenbezogene Informationen, bevor sie das Sprachmodell erreichen.

- Zweckbindung durch Architektur: KI-Agenten bekommen nur Zugriff auf die Tools und Daten, die sie für ihre Aufgabe brauchen. Guard Rails und limitierte Aktionen stellen sicher, dass das System nicht außerhalb seiner Grenzen agiert.

- 1 Prozent Budget für Security: OWASP Top 10 Audits, regelmäßige Sicherheitsprüfungen. Kein großer Aufwand, aber ein wichtiger.

Auch für Unternehmen mit hohen Vertraulichkeitsanforderungen funktioniert dieses Modell besonders gut. Die Kombination aus Azure-Vertrag und Pseudonymisierung erfüllt die Anforderungen von Unternehmen mit strengen Vertraulichkeitsanforderungen.

Der Mensch bleibt verantwortlich. Das ist kein Kompromiss.

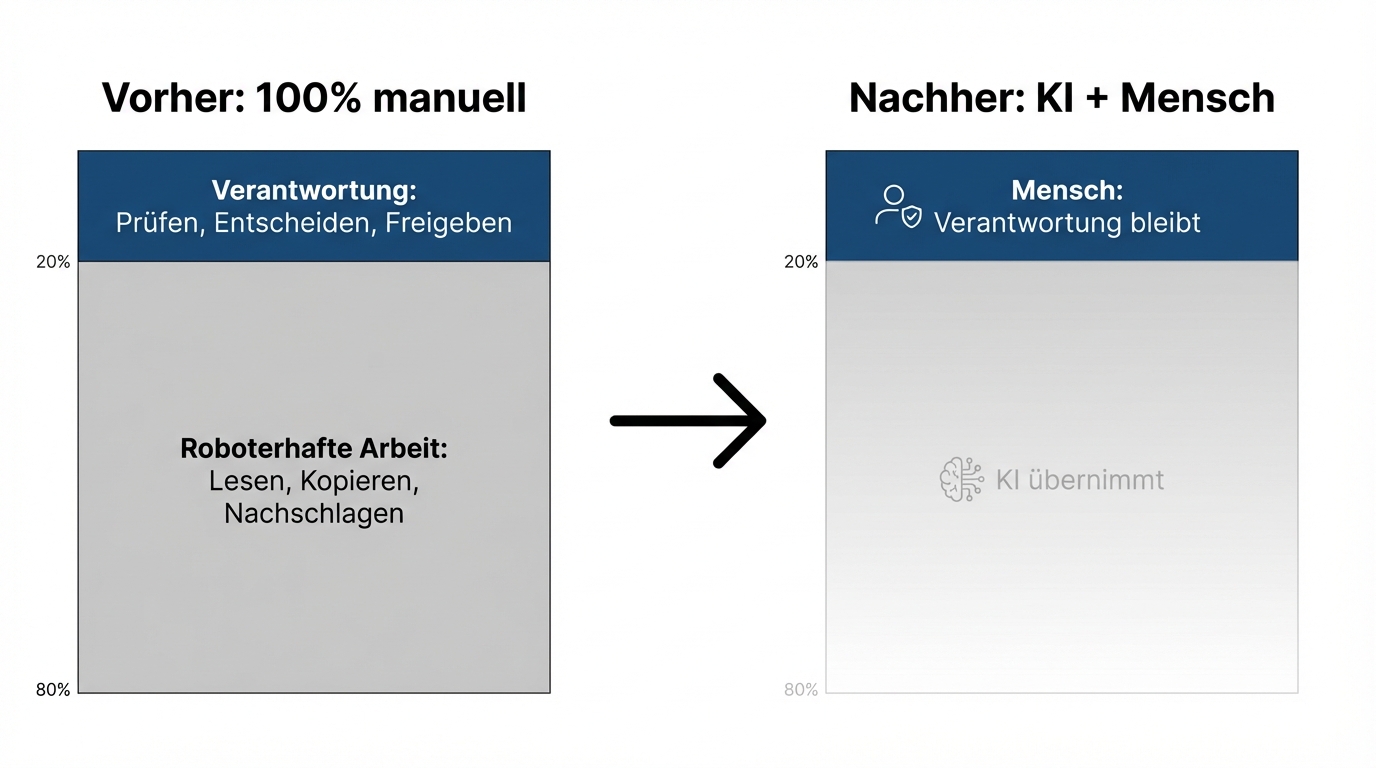

Human in the Loop klingt nach Einschränkung: Die KI könnte autonom arbeiten, aber wir lassen es aus Vorsicht nicht zu. Das ist ein Missverständnis.

Human in the Loop ist die richtige Architektur, nicht eine vorsichtige. In den allermeisten Geschäftsprozessen ist 80 Prozent des Zeitaufwands roboterartige Arbeit: Dokumente lesen, Informationen zusammentragen, Entwürfe erstellen. Diese Arbeit übernimmt die KI. Die verbleibenden 20 Prozent sind Urteil, Verantwortung, Entscheidung. Die bleiben beim Menschen, und sie werden wichtiger, nicht weniger wichtig.

Ein Angebot, das die KI erstellt hat, muss jemand freigeben, der es verantworten kann. Eine Zusammenfassung, die das System generiert, muss jemand prüfen, der den Kontext kennt. Das ist keine Bremse. Das ist die Architektur, die Vertrauen schafft, bei Kunden, bei Mitarbeitern und bei Aufsichtsbehörden.

Für den EU AI Act bedeutet das konkret: Hochrisiko-Anwendungen erfordern menschliche Aufsicht. Wer von Anfang an mit Human in the Loop arbeitet, erfüllt diese Anforderung automatisch. Wer KI-Systeme ohne menschliche Kontrolle baut, muss später umbauen.

EU AI Act: Was jetzt schon gilt und was kommt

Seit dem 2. Februar 2025 gelten die ersten Pflichten aus dem EU AI Act. Für die meisten Mittelständler sind zwei Punkte relevant:

Erstens: KI-Kompetenz. Unternehmen müssen sicherstellen, dass Mitarbeiter, die KI-Systeme nutzen, ausreichend geschult sind. In der Praxis heißt das: Feedbackworkshops, Prompting-Training, Verständnis für Möglichkeiten und Grenzen. Das klingt nach viel, ist aber pragmatisch lösbar. Wer regelmäßige Workshops durchführt und dokumentiert, erfüllt die Anforderung.

Zweitens: Transparenz. Unternehmen müssen offenlegen, wo KI eingesetzt wird. Nutzungsbedingungen und interne Richtlinien müssen angepasst werden. Auch das ist Architektur-Arbeit, keine Rechts-Odyssee.

Der wichtigste Rat: Nicht auf die nächste Regulierungswelle warten, sondern jetzt die Grundlagen schaffen. Wer heute mit Privacy by Design, Human in the Loop und transparenter Dokumentation startet, ist für alles gewappnet, was noch kommt.

Für wen das funktioniert

Datenschutzkonforme KI-Implementierung eignet sich besonders für Unternehmen mit:

- Regelmäßigem Umgang mit personenbezogenen Daten: Kundendaten, Mitarbeiterdaten, Finanzdaten als Teil der täglichen Arbeit

- Hohen Vertraulichkeitsanforderungen: Unternehmen, die sensible Daten verarbeiten und KI nutzen wollen, ohne ihre Vertraulichkeitspflichten zu verletzen

- Bestehender Microsoft-Infrastruktur: Wer Office 365 oder Azure nutzt, hat den Rahmenvertrag bereits

- Konkretem Automatisierungsziel: Ein Prozess, der heute manuell läuft und mit KI schneller, besser oder günstiger werden soll

Was es braucht: Jemanden im Unternehmen, der den Datenschutz nicht als Blockade versteht, sondern als gestaltbare Rahmenbedingung. Die technischen Lösungen existieren. Die Vertragsstrukturen existieren. Es fehlt meistens nur die Entscheidung, sie zu nutzen.