Fachverlage, Verbände und Akademien sitzen auf einem Schatz: jahrelang kuratiertes Expertenwissen in Form von Webinaren, Gutachten, Handbüchern und Fachartikeln. Dieses Wissen ist wertvoll, aber schwer zugänglich. Ein Steuerberater, der eine spezifische Frage zu E-Bike-Versteuerung hat, muss sich durch Stunden von Webinar-Material arbeiten. Ein Brandschutzplaner, der die Vorschriften für ein Atrium in Hamburg braucht, durchsucht Dutzende Richtlinien.

Ein KI-Experten-Chatbot macht dieses Fachwissen interaktiv zugänglich: Fachfragen stellen, präzise Antworten erhalten, jede Aussage bis zur Originalquelle zurückverfolgen. Das Muster funktioniert domänenübergreifend und läuft in mehreren Fachbereichen seit über einem Jahr mit Zehntausenden Anfragen pro Monat im Produktivbetrieb.

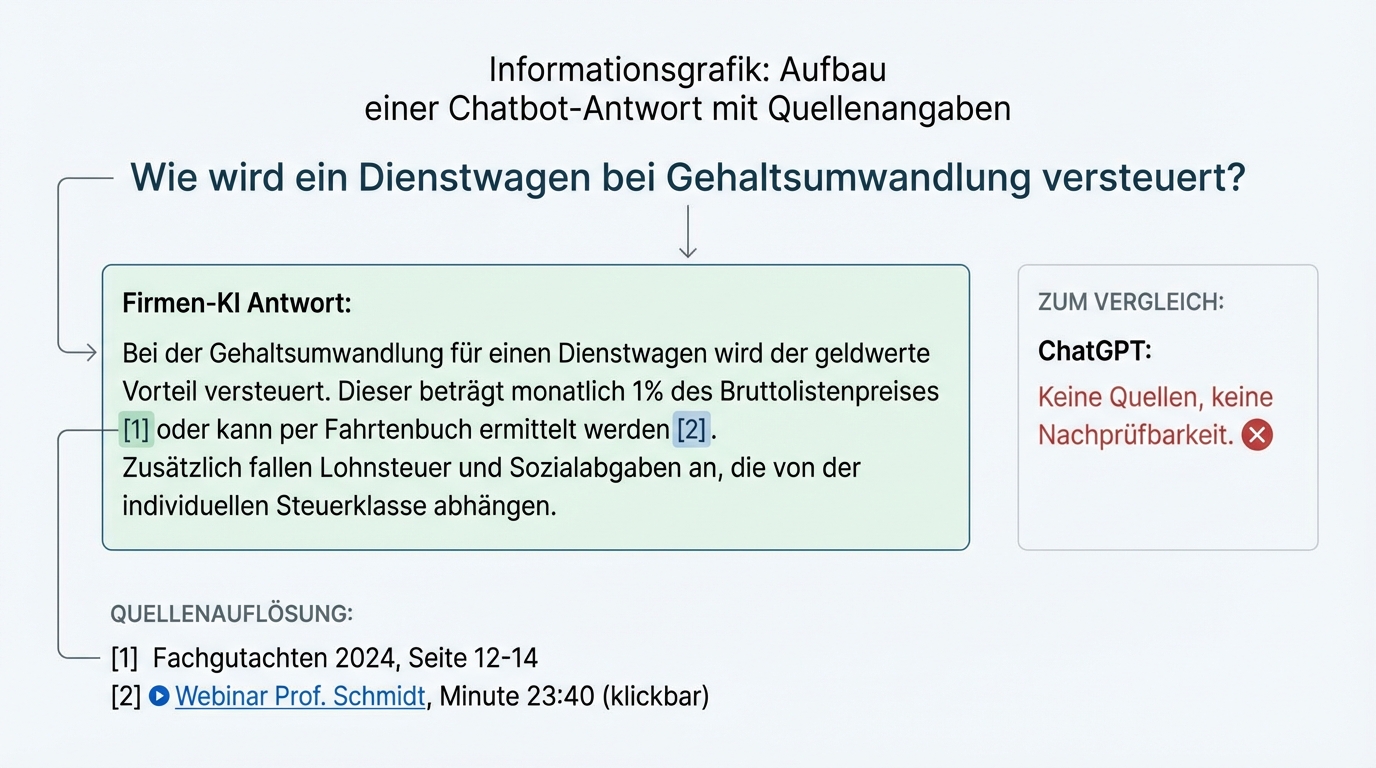

Quellenangaben sind kein Feature, sondern die Grundvoraussetzung

Der wichtigste Unterschied zwischen einem Fach-Chatbot und ChatGPT ist nicht die Antwortqualität. Es ist die Nachvollziehbarkeit.

Jede Antwort eines Fach-Chatbots muss rückverfolgbar sein bis zur Originalquelle. Wenn ein Steuerberater eine Antwort zur Umsatzsteuer bekommt, klickt er auf die Quellenangabe und sieht das zugrundeliegende Kurzgutachten. Wenn ein Teilnehmer eine Frage zu einem vierstündigen Webinar stellt, springt er per Klick an die exakte Minute im Video, an der die Antwort gegeben wurde.

Ohne diese Transparenz ist ein Fach-Chatbot wertlos. Kein Experte vertraut einer Blackbox. Fachleute brauchen die Möglichkeit, die Antwort gegen die Originalquelle zu prüfen. Das ist kein Zusatzfeature, sondern das zentrale Vertrauensmerkmal, das in mehreren Fachdomänen über 18 Monate hinweg bestätigt wurde: Steuerrecht, Arbeitsschutz, Brandschutz, Fachberatung.

Die Quellenangaben lösen gleichzeitig ein zweites Problem: Sie machen den Chatbot zum Zugangstor für den gesamten Content. Ein Nutzer, der eine Frage stellt und als Antwort einen relevanten Ausschnitt aus einem Webinar erhält, wird dieses Webinar mit höherer Wahrscheinlichkeit vollständig ansehen als jemand, der es blind aus einem Katalog auswählt.

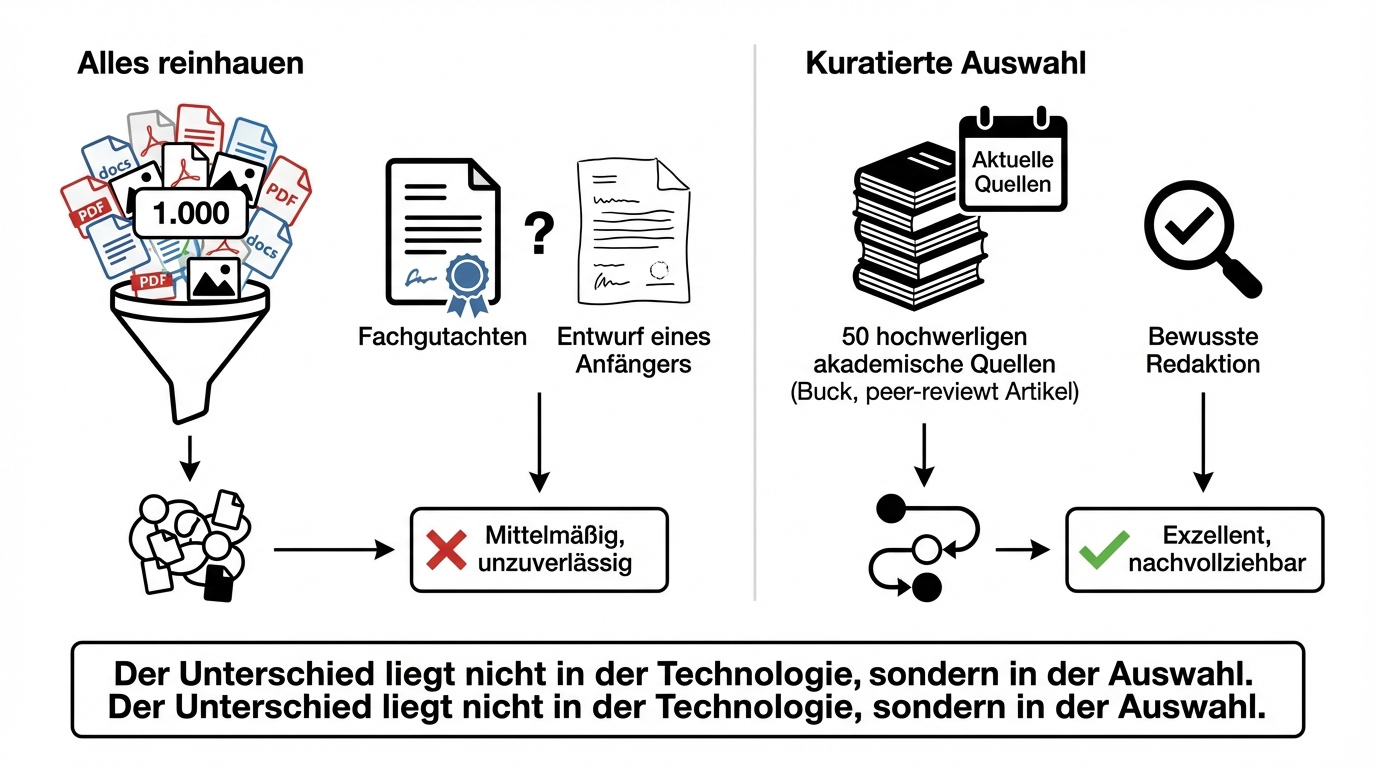

Kuratierung schlägt Masse: Warum "alles reinhauen" scheitert

Der häufigste Fehler beim Aufbau eines Fach-Chatbots: alle verfügbaren Dokumente in eine Datenbank laden und hoffen, dass die KI schon die richtigen Stellen findet.

Das funktioniert nicht. Wenn in derselben Wissensbasis ein sorgfältig recherchiertes Fachgutachten neben einem oberflächlichen Entwurf eines Berufsanfängers liegt, sind beide für die KI gleichwertig. Die Ergebnisse werden mittelmäßig, weil die Qualität der Wissensbasis die Qualität der Antworten bestimmt.

Der Unterschied zwischen einem mittelmäßigen und einem exzellenten Chatbot liegt nicht in der Technologie. Er liegt in der bewussten Entscheidung, welche Dokumente in die Wissensbasis aufgenommen werden und welche nicht. Was ist aktuell? Was hat die nötige fachliche Tiefe? Welches Ergebnis erwarten wir bei einer bestimmten Frage?

Diese Kuratierung ist keine einmalige Aufgabe. Im laufenden Betrieb wertet ein Redakteur wöchentlich automatische Reports aus, die zeigen, welche Fragen mangels passender Quellen nicht gut beantwortet werden konnten. Die Wissensbasis wächst nicht unkontrolliert, sondern wird aktiv gepflegt. Das ist ein Standardgeschäftsmodell, das Fachverlage seit Jahrzehnten kennen, nur auf ein neues Medium übertragen.

Echte Expertengespräche sind die beste Wissensbasis

Die besten Trainingsdaten für einen Experten-Chatbot sind nicht Lehrbücher oder Handbücher. Es sind echte, aufgezeichnete Beratungsgespräche.

Ein Coaching-Chatbot, der seit über einem Jahr im Einsatz ist, basiert auf über 9.000 Minuten Videomaterial und mehreren Fachbüchern. Die Kombination aus echten Gesprächen und strukturiertem Material ergibt eine Wissensbasis, die nicht nur Fakten liefert, sondern auch den Gesprächsstil und die Argumentationslogik des Experten widerspiegelt.

Aufgezeichnete Beratungsgespräche plus der existierende Gesprächsleitfaden bringen erfahrungsgemäß bereits 80 bis 90 Prozent der nötigen Wissensbasis zusammen. Der Rest wird durch gezieltes Feedback im laufenden Betrieb ergänzt.

Videos werden dabei per Spracherkennung zu Transkripten mit satzgenauen Zeitstempeln verarbeitet. PDFs durchlaufen eine Erkennung, die auch Tabellen und komplexe Layouts korrekt erfasst. Unterschiedliche Medientypen erfordern unterschiedliche Verarbeitungspipelines, aber das Ergebnis ist eine einheitliche, durchsuchbare Wissensbasis.

Der Chatbot muss die Fachdomäne verstehen, nicht nur Dokumente finden

Dokumente in eine Datenbank laden und eine Suchfunktion darüberlegen reicht für einfache Anwendungsfälle. Für echte Fachfragen reicht es nicht.

Ein Chatbot für Brandschutzrecht muss erkennen, ob der Fragesteller in Hamburg oder München plant, ob es um ein Hochhaus oder ein Holzhaus geht, ob gewerbliche oder private Nutzung vorliegt. Je nach Antwort gelten völlig unterschiedliche Vorschriften. Diese domänenspezifische Logik steckt nicht in den Dokumenten selbst, sondern wird als Konfiguration in den Chatbot eingebaut: Glossare, Fachabkürzungen, Metadaten-Einschränkungen, die je nach Nutzerkontext unterschiedliche Quellen priorisieren.

Das ist auch der Grund, warum Basismodelle wie ChatGPT diese Aufgabe nicht übernehmen können, selbst wenn sie Zugang zu denselben Quellen hätten. Die domänenspezifischen Logiken, der kuratierte Benchmark-Datensatz und die Erfahrung aus Zehntausenden realen Anfragen bilden zusammen einen Wettbewerbsvorteil, den ein allgemeines Sprachmodell nicht replizieren kann. Fachverlage werden ihre Quellen zudem kaum freiwillig in Basismodelle einfließen lassen, weil das zu deutlich geringeren Einnahmen führen würde.

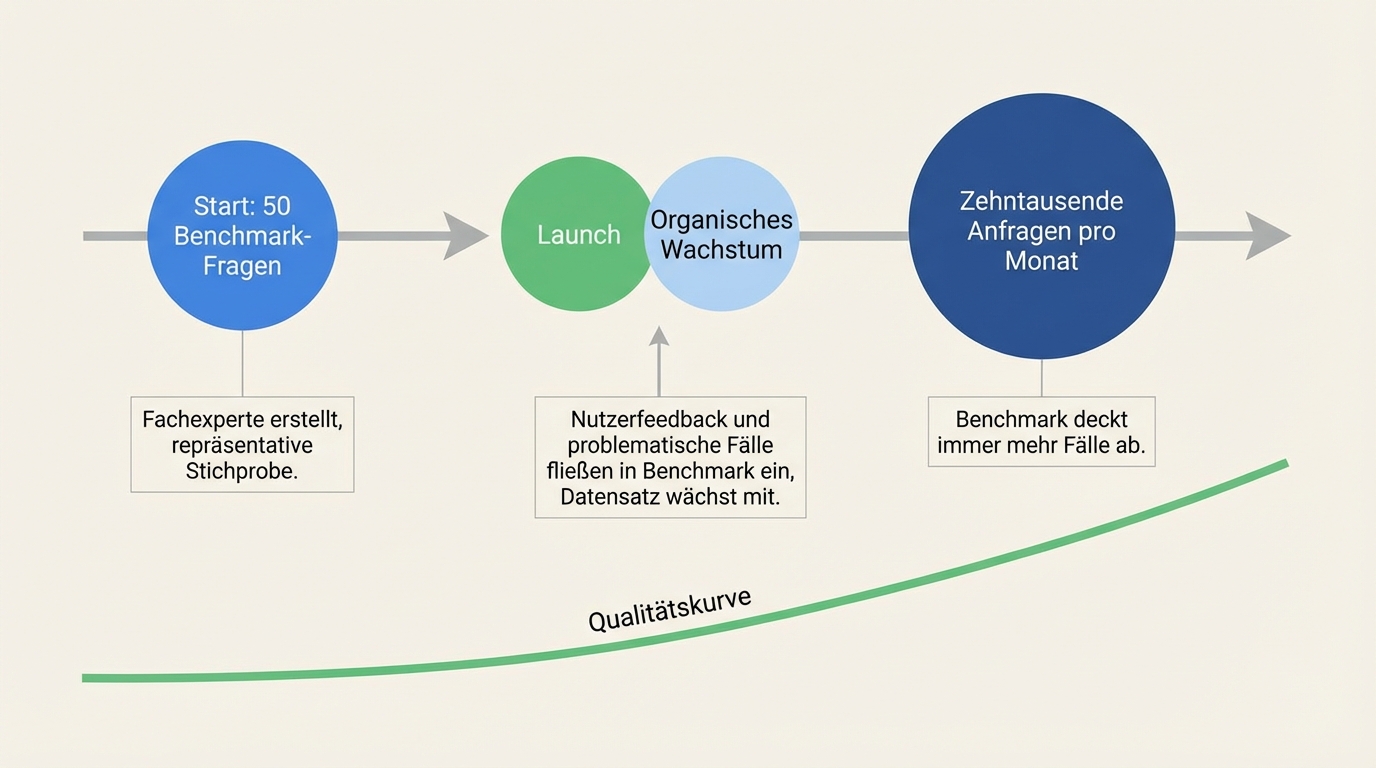

Qualitätssicherung: Von 50 Benchmark-Fragen zu Zehntausenden Anfragen pro Monat

Die Qualitätssicherung eines Fach-Chatbots beginnt vor dem Launch und wächst danach organisch weiter.

Vor dem Start erstellt ein Fachexperte rund 50 Benchmark-Fragen mit erwarteten Antworten und Quellenangaben. Diese Fragen sind eine repräsentative Stichprobe über verschiedene Wissensgebiete. Sie ermöglichen es, die Systemqualität schnell einzuschätzen und die Kernfunktionalität innerhalb weniger Wochen auf ein gutes Niveau zu bringen.

Im laufenden Betrieb kommen zwei Mechanismen hinzu: Erstens geben Nutzer Feedback zu besonders guten oder schlechten Antworten. Zweitens werden problematische Anfragen (schlechte Traces) in den Benchmark-Datensatz aufgenommen. Das System wird angepasst, und der Datensatz wächst organisch mit den realen Nutzungsdaten. So deckt die Qualitätssicherung immer mehr Fälle ab, ohne dass jemand manuell Tausende Testfragen schreiben muss.

Nutzungsstatistiken ergänzen das Bild: Wie viele Nutzer greifen zu? Wie viele Fragen werden gestellt? Welche Themengebiete sind besonders gefragt? Diese Zahlen sind entscheidend, um den Wert des Chatbots gegenüber der eigenen Organisation nachzuweisen.

Der Agent Operator: Eine neue Rolle zwischen Technik und Fachbereich

Für den Betrieb eines Fach-Chatbots braucht es eine Rolle, die es vorher nicht gab: den Agent Operator. Das ist kein Entwickler und kein Manager, sondern ein Fachexperte, der das System regelmäßig ausprobiert, die Ergebnisse bewertet und in natürlicher Sprache Feedback gibt.

Das Besondere: Diese Rolle erfordert keine technischen Fähigkeiten. Die Steuerung des Systems geschieht in natürlicher Sprache. Der Agent Operator sagt: "Die Antwort war zu kurz, die Quellenangabe fehlt, hier hätte noch das Gutachten von 2023 zitiert werden müssen." Das Entwicklungsteam setzt das um.

In der Praxis investiert der Agent Operator anfangs etwa vier Stunden pro Woche, danach etwa zwei. Er kann die Aufgabe an Redakteure delegieren, die wöchentliche Reports auswerten und die Wissensbasis pflegen. Das Wissen steckt nicht nur im Kopf einer Person, sondern wird in den Konfigurationen und Prompts des Systems dokumentiert. Bei größeren Organisationen werden mehrere Personen für diese Rolle ausgebildet, mit regelmäßigem Austausch.

Vom Frage-Chatbot zum Zugangstor für den gesamten Content

Ein Fach-Chatbot beginnt als Werkzeug für Fachfragen. In der Praxis entwickelt er sich schnell weiter.

Die Kernfunktionalität, Fachfragen mit quellengestützten Antworten zu beantworten, steht erfahrungsgemäß innerhalb weniger Wochen. Auf diesem Fundament lassen sich zusätzliche Funktionen aufbauen: Dokumentengenerierung (aus einer Fachfrage wird eine E-Mail an den Geschäftsführer oder ein Kurzgutachten), Zugang zu geschützten Inhalten (der Chatbot verwaltet, welche Videos ein Nutzer sehen darf) oder die Integration in bestehende Plattformen und Mitgliederbereiche.

Ein Fachverband nutzt den Chatbot beispielsweise als Einstieg für seine Mitglieder: kostenlose Fragen als Kennenlern-Angebot, dann ein Abo-Modell für unbegrenzten Zugang. Nicht-Mitglieder können den Chatbot testen, bevor sie sich für eine Mitgliedschaft entscheiden. Der Chatbot wird so gleichzeitig zum Kundenservice-Tool und zum Akquise-Instrument.

Was die Einführung erfordert

Drei Voraussetzungen entscheiden über den Erfolg:

Kuratierte Fachquellen statt Datenflut. Nicht jedes Dokument gehört in die Wissensbasis. Zehn gut ausgewählte Fachgutachten liefern bessere Ergebnisse als tausend unsortierte Dateien. Die bewusste Auswahl ist der erste und wichtigste Schritt.

Ein Fachexperte, der das System bewertet. Der Agent Operator braucht keine technischen Kenntnisse, aber tiefes Domänenwissen. Er bewertet die Antworten, meldet Lücken und steuert die Weiterentwicklung. Anfangs vier Stunden pro Woche, danach zwei.

Benchmark-Fragen als Qualitätsanker. 50 beispielhafte Fragen mit erwarteten Antworten und Quellenverweisen bilden das Fundament der Qualitätssicherung. Der Aufwand für die Erstellung ist überschaubar, der Nutzen für die schnelle Einschätzung der Systemqualität erheblich.