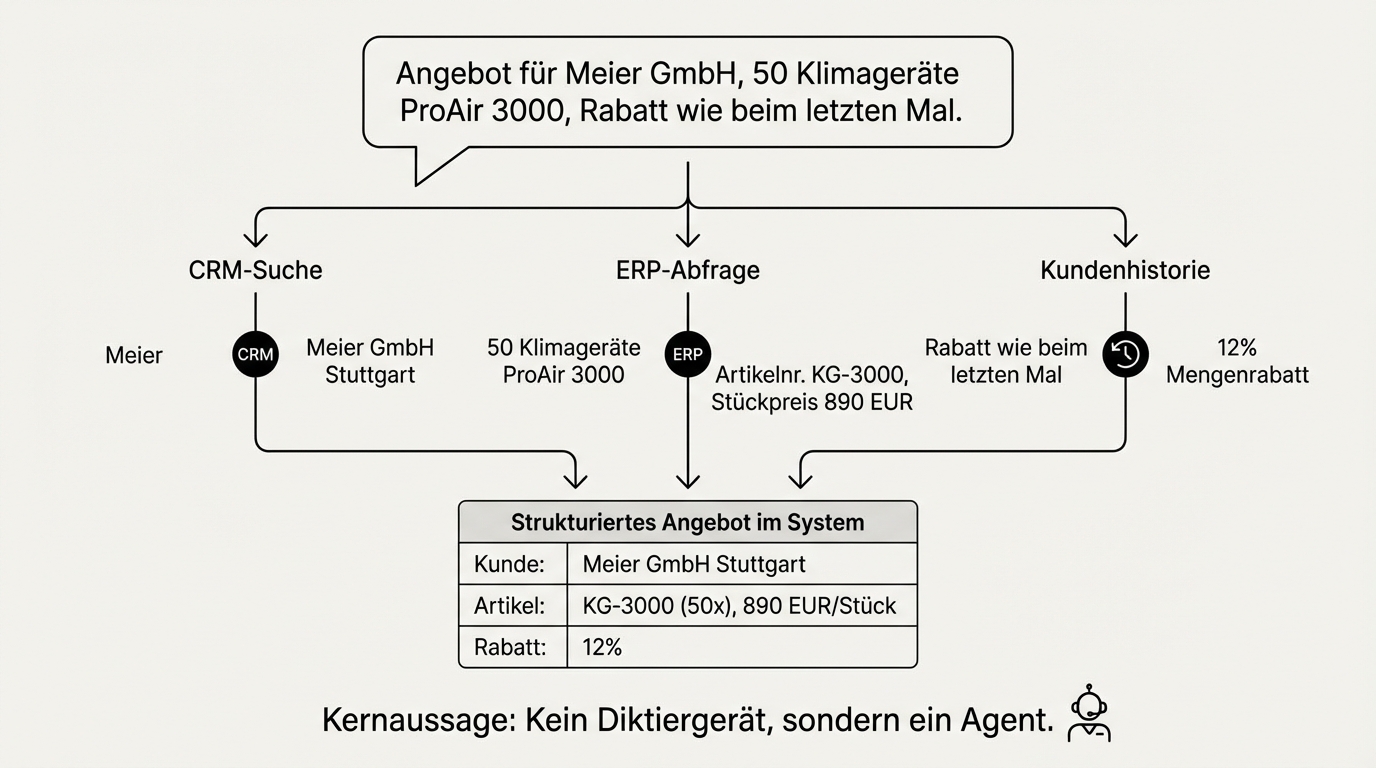

Ein Vertriebsmitarbeiter kommt aus dem Kundentermin, greift zum Telefon und spricht: "Angebot für Meier GmbH, 50 Klimageräte Modell ProAir 3000, Lieferung bis Ende Juni, Rabatt wie beim letzten Mal." Wenige Minuten später liegt ein strukturiertes Angebot im System. Die Artikelnummer wurde aus dem Produktkatalog ermittelt, der Rabatt aus der Kundenhistorie übernommen, die Lieferzeit gegen den aktuellen Lagerbestand geprüft.

Das ist keine Zukunftsvision. Es funktioniert heute, weil sich in den letzten zwei Jahren die Art verändert hat, wie Unternehmenssoftware Eingaben verarbeitet. Statt Formulare auszufüllen, statt die richtige Maske in der richtigen Reihenfolge zu bedienen, spricht oder tippt man in natürlicher Sprache. Die KI übersetzt das in strukturierte Daten und Aktionen.

Die eigentliche Fähigkeit ist nicht Spracherkennung

Wer über Spracheingabe in Unternehmenssoftware nachdenkt, denkt zuerst an Spracherkennung. An Mikrofone, an Transkription, an Dialekte. Das ist der falsche Einstieg. Spracherkennung ist ein gelöstes Problem. Aktuelle Modelle erkennen bayerischen Dialekt ebenso zuverlässig wie Hochdeutsch, und selbst Fachterminologie lässt sich durch eine Nachbearbeitungsstufe korrigieren, die das Transkript mit einem fachspezifischen Glossar abgleicht.

Die eigentliche Fähigkeit ist eine andere: natürliche Sprache verstehen und in strukturierte Aktionen übersetzen. Aus "Angebot für Müller" wird eine Kundensuche. Aus "200 Stück Classic" wird eine Artikelzuordnung. Aus "Rabatt wie beim letzten Mal" wird eine Abfrage der Kundenhistorie. Das ist kein Diktiergerät, sondern ein Agent, der versteht, was gemeint ist, und selbstständig handelt.

Sprache und Text sind austauschbare Eingabekanäle

Eine Erkenntnis, die sich in unseren Projekten über Monate gefestigt hat: Sprache und Text sind nur verschiedene Eingabekanäle für denselben Agenten. Das Sprachmodell ist im Kern ein User Interface. Dahinter laufen dieselben Backend-Agenten, dieselbe Geschäftslogik, dieselben Systemanbindungen. Ob jemand eine Anfrage eintippt oder einspricht, macht für das System keinen Unterschied.

Das verändert die Projektplanung grundlegend. Man baut nicht zuerst einen Voicebot und dann einen Chatbot. Man baut die Geschäftslogik einmal und schaltet danach beliebige Eingabekanäle davor. Ein Agent, der schriftlich eingehende Anfragen bearbeitet, kann mit überschaubarem Aufwand auch per Sprache bedient werden. Der umgekehrte Weg funktioniert genauso.

In der Praxis heißt das: Wenn ein System per Chat funktioniert, ist der Schritt zu Spracheingabe kein neues Projekt, sondern eine Erweiterung des bestehenden. Die Investition in die Geschäftslogik zahlt sich doppelt aus.

Wo Spracheingabe dem Formular überlegen ist

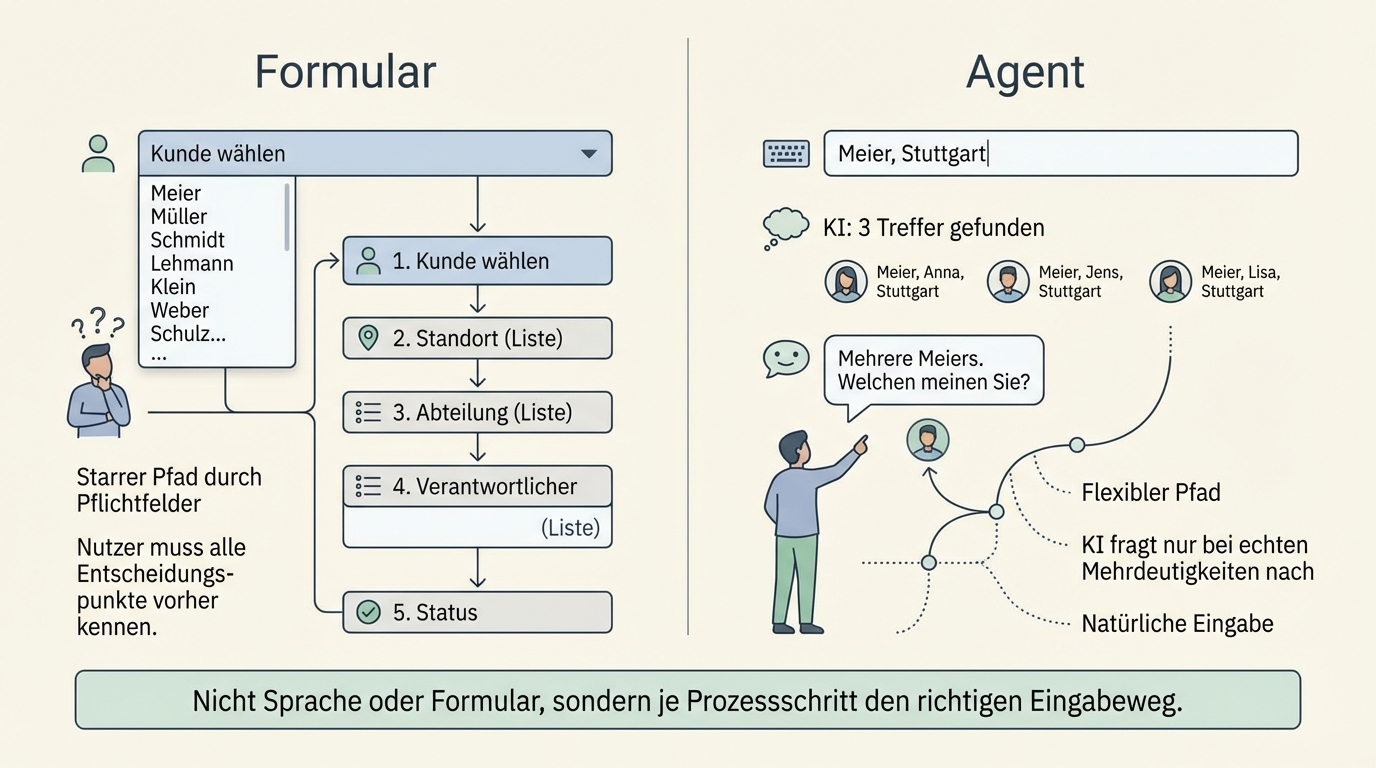

Formulare zwingen den Nutzer in eine vorgegebene Struktur. Das funktioniert, solange die Eingabe eindeutig ist. Aber viele Geschäftsprozesse sind nicht eindeutig.

"Erstell ein Angebot für den Müller." Welcher Müller? Ein Formular bräuchte ein Dropdown mit allen Kunden namens Müller. Oder ein Suchfeld mit Filtern. Der Nutzer müsste wissen, dass er erst den Kunden suchen muss, dann die Adresse prüfen, dann die Produktkategorie wählen. Ein Agent mit Zugriff auf die Kundendaten findet acht Treffer, erkennt aus dem Kontext, dass es sich vermutlich um die Müller GmbH in Stuttgart handelt, und fragt nur nach, wenn es tatsächlich unklar ist.

Spracheingabe funktioniert überall dort besonders gut, wo der Prozess Entscheidungspunkte hat, die vorher nicht alle bekannt sind. Ein Formular muss jeden möglichen Pfad vorher kennen. Ein Agent kann flexibel reagieren, nachfragen und den Kontext nutzen, um die richtige Entscheidung zu treffen.

Die Kehrseite: Für strukturierte, vorhersagbare Eingaben bleibt ein gut designtes Formular effizienter. Die Frage ist nicht "Sprache oder Formular", sondern "Wo im Prozess lohnt sich welcher Eingabeweg?"

Der häufigste Anwendungsfall: Standardanfragen automatisieren

Die naheliegendste Anwendung sind repetitive Standardanfragen. Preis- und Lieferzeitanfragen per Telefon, Standard-Supportfragen, wiederkehrende Bestellungen. In einem Industrieunternehmen haben wir festgestellt, dass ein Großteil der eingehenden Anrufe dieselbe Struktur hat: Kunde nennt Artikelnummer, fragt nach Preis und Verfügbarkeit.

Solche Anfragen zu automatisieren funktioniert, weil sie vorhersagbar sind. Die KI versteht die Anfrage, fragt bei Unklarheiten nach, gleicht die Informationen mit dem ERP-System ab und liefert eine Antwort. Der Mitarbeiter wird von repetitiver Arbeit befreit und kann sich auf die komplexen Fälle konzentrieren, die tatsächlich menschliches Urteilsvermögen erfordern.

Die Erfahrung zeigt: Unternehmen, die Standardanfragen automatisieren, gewinnen nicht nur Zeit. Sie gewinnen auch Kapazität für die Fälle, die den Unterschied zum Wettbewerb ausmachen.

Wissen wird greifbar, weil die KI es einfordert

Ein Nebeneffekt, der sich als einer der wertvollsten herausstellt: Die Einführung von natürlicher Sprache als Eingabekanal zwingt Organisationen, ihr implizites Wissen zu artikulieren.

Wenn ein Vertriebsmitarbeiter seine Anfrage einfach einspricht und das System die richtige Entscheidung treffen soll, muss das System wissen, wie die richtige Entscheidung aussieht. Welche Rabattstufen gibt es? Unter welchen Bedingungen gilt welcher Preis? Welche Produkte sind kompatibel? All das ist in vielen Unternehmen Wissen, das in den Köpfen einzelner Personen steckt, aber nirgends dokumentiert ist.

Die KI erzwingt diese Dokumentation, weil sie ohne explizite Regeln keine guten Entscheidungen treffen kann. Das ist kein Dokumentationsprojekt im klassischen Sinn, das neben dem Tagesgeschäft läuft und irgendwann veraltet. Es ist eine Wissensbasis, die aktiv genutzt wird und durch jede Korrektur besser wird.

Was Spracheingabe nicht ist: Ein universeller Standardpfad

Spracheingabe im Großraumbüro funktioniert nicht. Zu laut, zu wenig Privatsphäre, sozial unpassend. Im Homeoffice oder im Auto dagegen ist sie der natürlichste Eingabeweg. Die Entscheidung für oder gegen Spracheingabe ist keine Technologiefrage, sondern eine Kontextfrage.

Auch gibt es eine generationenbedingte Komponente: Wer gewohnt ist, per Sprachnachricht zu kommunizieren, empfindet Spracheingabe in Software als selbstverständlich. Wer hauptsächlich tippt, bevorzugt den Chatbot. Ein gutes System bietet beides an und überlässt die Wahl dem Nutzer.

Wenn die KI sich verhört: Rückbestätigung statt blindes Vertrauen

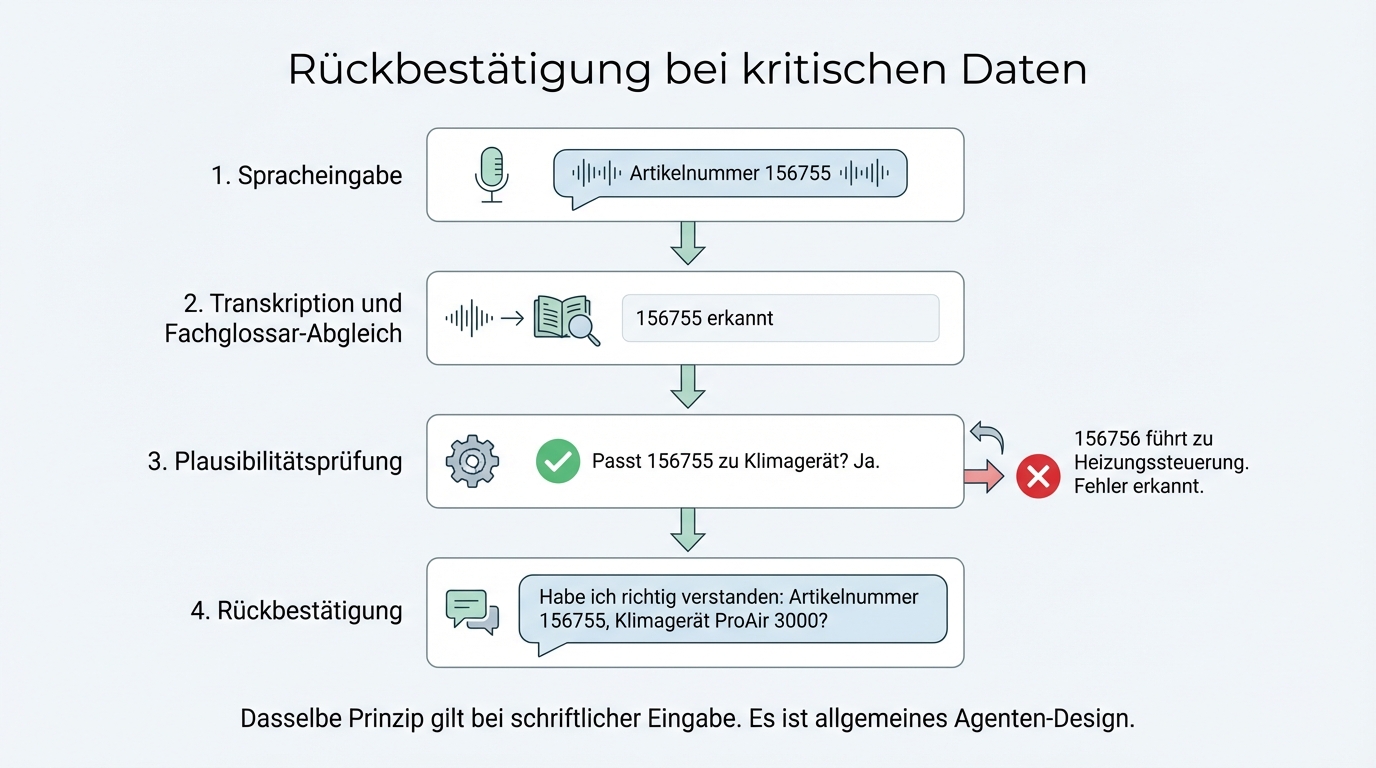

Was passiert, wenn die Spracherkennung eine Artikelnummer falsch erkennt? Wenn aus "156755" plötzlich "156756" wird und das falsche Produkt im Angebot landet?

Die Lösung ist dieselbe, die ein guter Callcenter-Mitarbeiter anwenden würde: Rückbestätigung bei kritischen Informationen. "Habe ich richtig verstanden, Artikelnummer 156755?" Zusätzlich prüft die KI inhaltlich, ob die erkannte Nummer zum beschriebenen Produkt passt. Wenn ein Kunde nach einem Klimagerät fragt, aber die erkannte Artikelnummer zu einer Heizungssteuerung führt, liegt offensichtlich ein Fehler vor.

Das ist kein sprachspezifisches Problem. Es ist allgemeines Agenten-Design: Wichtige Informationen werden rückbestätigt und plausibilitätsgeprüft. Dasselbe Prinzip gilt auch bei schriftlicher Eingabe, wenn ein Nutzer sich vertippt.

Datenschutz: Pragmatisch statt perfekt

Sprachverarbeitung im Unternehmenskontext hat eine rechtliche Dimension. Stimmdaten sind biometrische Daten im Sinne der DSGVO und erfordern eine bewusste Handhabung.

In der Praxis hat sich ein pragmatischer Ansatz bewährt: Stimmdaten werden sofort nach der Transkription gelöscht. Es wird kein Audio gespeichert, nur der transkribierte Text. Das reduziert die datenschutzrechtliche Angriffsfläche erheblich, weil aus einem Transkript keine biometrischen Merkmale mehr ableitbar sind.

Bei Meeting-Transkriptionen gilt eine zusätzliche Regel: Immer vorher fragen. Die Erfahrung zeigt, dass die Akzeptanz hoch ist, wenn man transparent kommuniziert, dass nur transkribiert und nicht aufgezeichnet wird. "Wir nutzen die Transkription, um die Ergebnisse des Meetings besser weiterverarbeiten zu können" ist ein Argument, das in der Praxis bei Kunden aller Größenordnungen funktioniert.

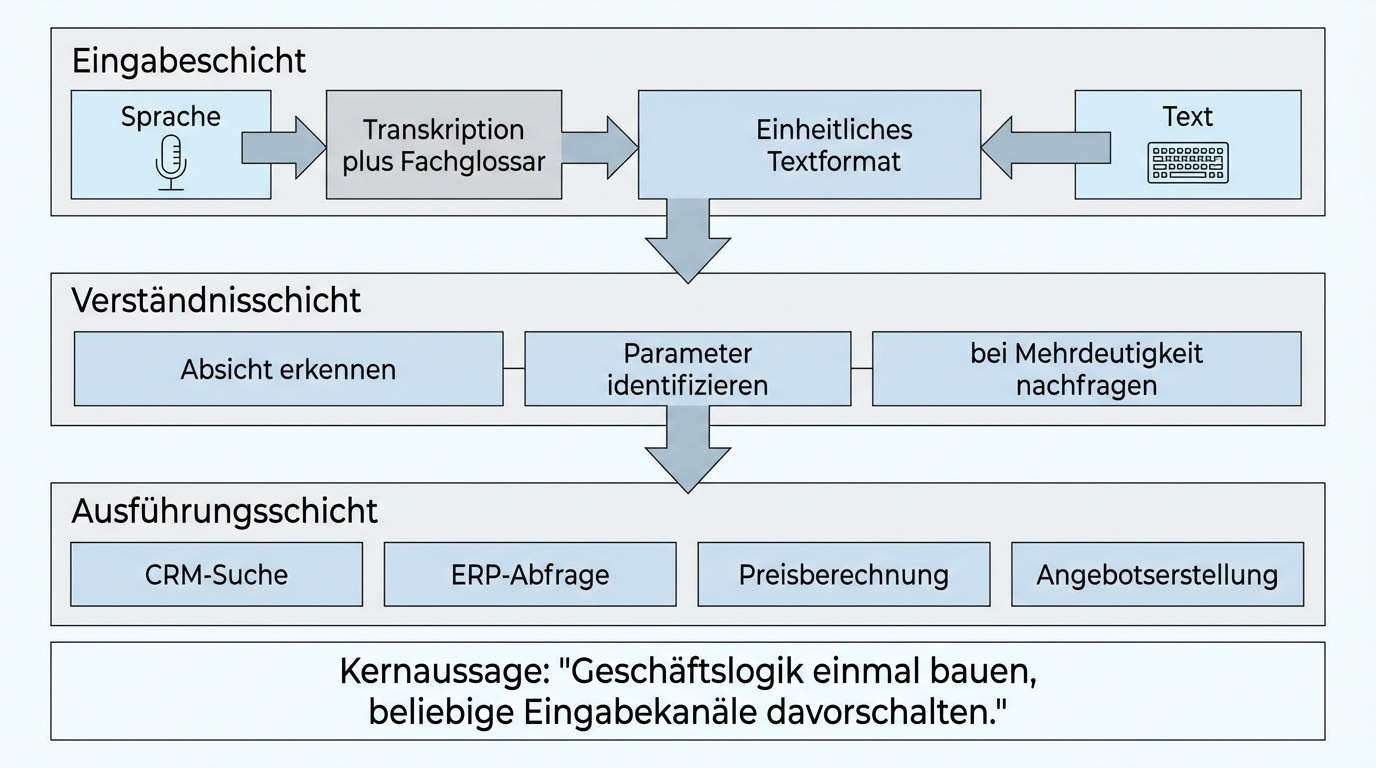

Die Architektur: Drei Schichten, sauber getrennt

Wer ein Natural-Language-Interface für Unternehmenssoftware baut, braucht drei Schichten:

Eingabeschicht: Sprache oder Text wird in ein einheitliches Textformat überführt. Bei Sprache bedeutet das: Transkription, Nachbearbeitung mit Fachglossar, optional Rückbestätigung kritischer Daten. Bei Text entfällt dieser Schritt.

Verständnisschicht: Der Agent interpretiert die Eingabe, ermittelt die Absicht und identifiziert die relevanten Parameter. "Angebot für Müller, 200 Stück Classic" wird zu: Aktion = Angebot erstellen, Kunde = Müller GmbH, Produkt = Classic, Menge = 200. Bei Mehrdeutigkeiten fragt der Agent nach.

Ausführungsschicht: Der Agent führt die identifizierte Aktion aus. Kundensuche im CRM, Artikelabfrage im ERP, Preisberechnung, Angebotserstellung. Diese Schicht ist identisch, egal ob die Eingabe per Sprache oder per Text kam.

Die saubere Trennung dieser Schichten ist der Schlüssel zur Wartbarkeit. Wenn sich die Spracherkennung verbessert, tauscht man die Eingabeschicht aus. Wenn sich ein Geschäftsprozess ändert, passt man die Ausführungsschicht an. Die Schichten beeinflussen sich nicht gegenseitig.

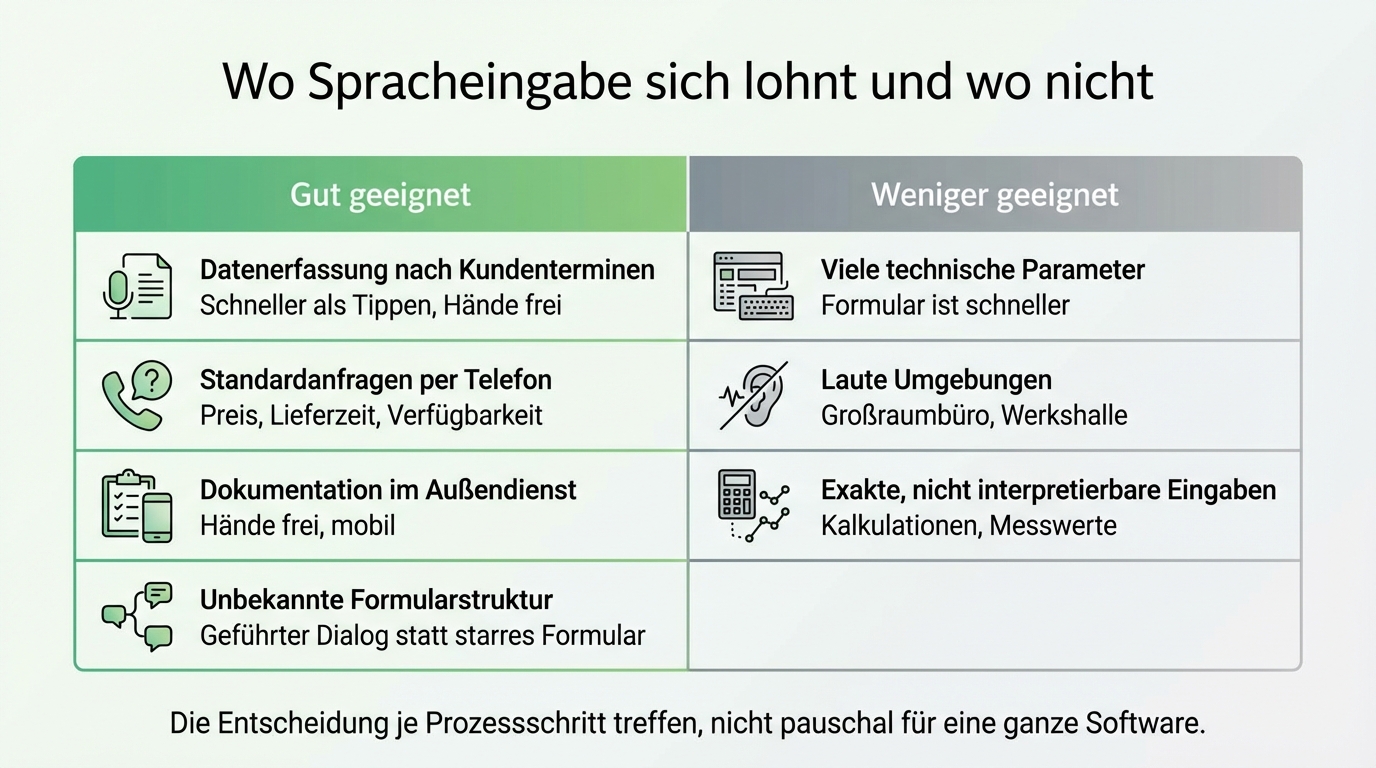

Nicht alles braucht Sprache

Spracheingabe ist ein Werkzeug, kein Ziel. Einige Prozesse profitieren davon, andere nicht.

Gut geeignet: Datenerfassung nach Kundenterminen (schneller als Tippen), Standardanfragen per Telefon (Preis, Lieferzeit, Verfügbarkeit), Dokumentation im Außendienst (Hände frei), und Situationen, in denen der Nutzer nicht weiß, welche Felder er ausfüllen muss (geführter Dialog statt starres Formular).

Weniger geeignet: Hochstrukturierte Eingaben mit vielen technischen Parametern (ein Formular ist schneller), Umgebungen mit hohem Lärmpegel, und Prozesse, bei denen die Eingabe exakt und nicht interpretierbar sein muss (z.B. Kalkulationen).

Die Entscheidung sollte je Prozessschritt getroffen werden, nicht pauschal für eine ganze Software.